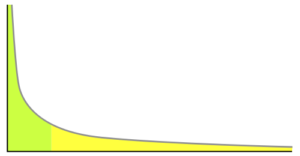

Im Jahr 2004 hat der US-Journlist und damalige Chefredakteur Wired Chris Anderson mit einem Buch die Theorie des „Long Tails“ populär gemacht. Im Internet, so der Kern dieser Theorie, kann auch der Handel mit Nischenprodukten gewinnbringend sein, schließlich hat man insbesondere bei virtuellen Gütern (z. B. Bücher und Musik) nur sehr geringe Herstellungs-, Lager- und Vertriebskosten, während man gleichzeitig eine sehr große Zahl an potenziellen Kunden in aller Welt ansprechen kann.

Ein sehr lesenswerter Beitrag von Klaus Graf hat mich nun auf den Gedanken gebracht, dass dies ganz ähnlich auch für die (Geschichts-)Wissenschaft gilt. In dem Beitrag argumentiert Graf, dass es besser wäre, wenn alle in Deutschland angefertigten Qualifikationsschriften, also Bachelor- und Masterarbeiten, Dissertationen und Habilitationen im Internet als Open-Access veröffentlicht werden, anstatt als Pflichtexemplare in Universitätsbibliotheken zu versauern oder als überteuerte Print-On-Demand-Bücher zum Teil fragwürdige Verlage zu finanzieren.

In den Kommentaren meines Post zur #digigw2013 (der Auftakttagung der „AG Digitale Geschichtswissenschaft“ des deutschen Historikerverbandes) habe ich einen ähnlichen Gedanken entwickelt. Um Studierende damit vertraut zu machen, dass Wissenschaft ein öffentlicher Prozess ist, halte ich es für sinnvoll, bereits für Masterarbeiten eine elektronische(!) open-access(!) Veröffentlichungspflicht in den Prüfungsordnungen festzulegen. Wie Klaus Graf ausgeführt hat, haben angenommene Masterarbeiten, bereits eine Art „Peer-Review“ durch die Prüfer hinter sich, erfüllen also wissenschaftliche Mindeststandards. Eine Überarbeitung, z. B. mit Hinweisen der Prüfer, zwischen Abgabe und Veröffentlichung der Arbeit sollte aber möglich sein.